Nell’epoca in cui l’intelligenza artificiale è diventata la nostra prima confidente per ogni dubbio o curiosità è piuttosto comune che molti inizino a utilizzarla anche per affrontare emozioni complesse, paure, ossessioni e conflitti interiori.

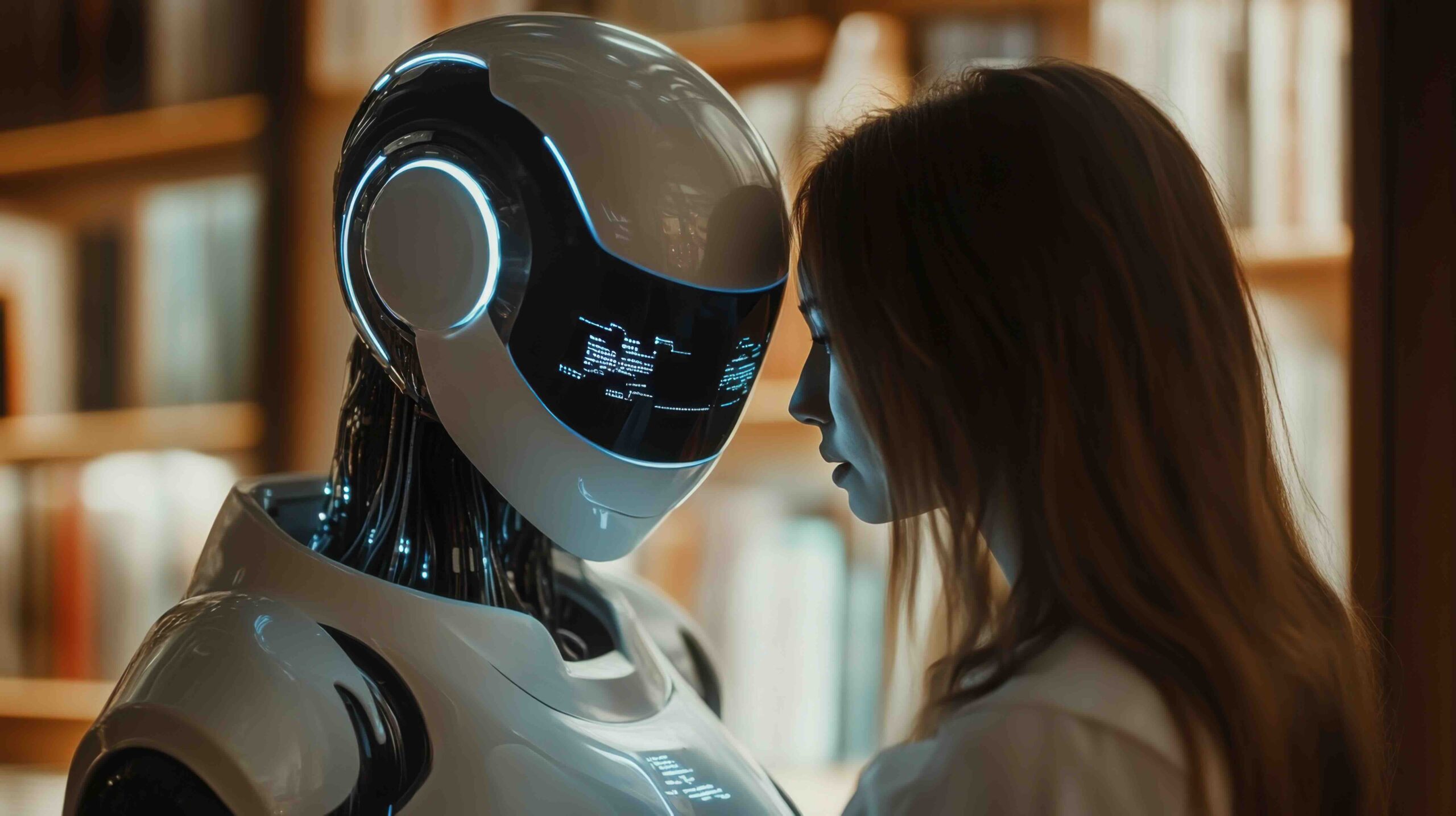

Cosa succede quando l’I.A. diventa un surrogato della relazione terapeutica? Sono in aumento le persone che si rivolgono a strumenti come ChatGPT per ricevere conforto, risposte e consigli su tematiche psicologiche, in una ricerca costante di sollievo e rassicurazione.

In questo post della sua rubrica sul Blog ClioMakeUp, il Dottor Giuseppe Femia, Psicologo, Psicoterapeuta, Psicodiagnosta, Scuola di Psicoterapia Cognitiva (SPC) e dell‘Associazione di Psicologia Cognitiva, esplora i rischi e i limiti dell’intelligenza artificiale nel contesto del disagio psicologico, mettendo in luce il confine sottile tra supporto e dipendenza, tra conforto e distorsione. Un’analisi attuale e profonda che ci invita a riflettere sul nostro rapporto con la tecnologia e con le nostre emozioni più intime. Siete curiose? Lasciamo subito la parola al Dottor Femia.

Credits: Foto di Adobe Stock | Tetlak

INTELLIGENZA ARTIFICIALE E PSICOLOGIA: AIUTO EMPATICO O RISCHIO DI DISTORSIONE COGNITIVA?

L’intelligenza artificiale è uno strumento a servizio della nostra psicologia e proprio per questo, chiaramente, può essere al servizio dei nostri più intimi e dannati dilemmi, dei nostri timori. Ormai siamo già al punto che chiediamo all’intelligenza artificiale ogni cosa e di conseguenza è normale che ci si rivolga alla ‘macchina’ anche per tutto quello che può riguardare le nostre paure.

Credits: Foto di Adobe Stock | ART STOCK CREATIVE

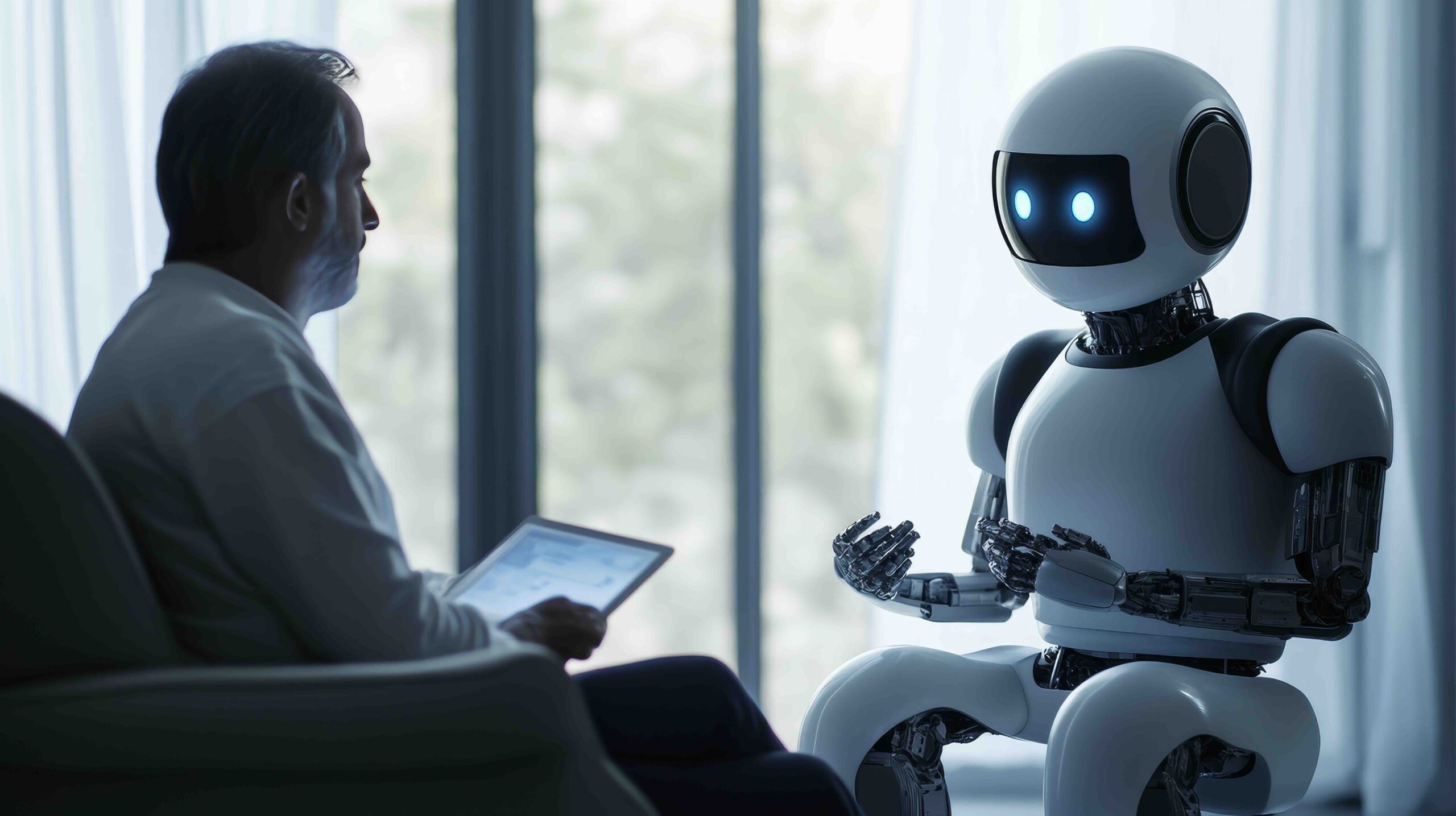

Come abbiamo già osservato nell’articolo sull’intelligenza artificiale e la psicoterapia, sono in molti a rivolgersi all’I.A. per trovare risposte e sollievo riguardo a disagi mentali e si scopre ora che effettivamente le diverse declinazioni personologiche ne fanno uso in relazione alla propria psicologia. Questo può portare a una sorta di pericoloso loop confirmatorio o al rischio speculare di rovesciare i propri timori trasformandoli nel loro contrario, un’aggressiva iper-accettazione di un bias cognitivo, ovvero una distorsione del processo cognitivo.

L’UTILIZZO DELL’INTELLIGENZA ARTIFICIALE IN BASE AI PROPRI DISAGI PSICOLOGICI

Gli ipocondriaci potrebbero cercare rassicurazioni mediche ed informazioni relative ai propri mostri legati all’ansia da malattia.

Gli ossessivi potrebbero provare a sciogliere i dubbi e le paure, con la tendenza a confessare i propri ‘vergognosi’ riti in cerca di rassicurazione, una rassicurazione che, però, rischia di non risolvere, ma, invece, di istigare alla continuazione degli stessi.

I paranoidi cercherebbero in modo compiacente di studiare le implicazioni in relazione ai timori di persecuzione, col rischio di passare dalla mania di persecuzione alla convinzione di poter controllare l’altro.

Credits: Foto di Adobe Stock | Elkhan Babayev

I disorganizzati potrebbero ricercare ordine e informazioni regolamentate alle proprie intuizioni e alla propria attività, gli iper-organizzati provano a distrarsi dalla loro routinaria giornata con controlli o aumentano la loro vigilanza su rischi e pericoli.

La vulnerabilità narcisistica può rischiare di prolungare la propria grandiosità attingendo a questo nuovo strumento che diventa un nuovo potere.

I narcisisti istrionici, poi, sono quelli più a rischio, perché rivolgendosi a uno strumento in qualche modo compiacente rischiano di aumentare e ingigantire le proprie caratteristiche di egocentrismo.

I LIMITI DELL’INTELLIGENZA ARTIFICIALE NELLA “COMPRENSIONE” DEL DISAGIO PSICOLOGICO

Tutto questo perché l’intelligenza artificiale ha, come contraltare della sua oggettività e mancanza di pregiudizi, il difetto di non poter individuare il limite oltre il quale non ci si può spingere nella ‘comprensione’ del disagio psicologico: basandosi su dati e non sull’empatia (anche se paradossalmente l’I.A. viene percepita come più empatica di un terapeuta in carne ed ossa perché non ha mai giornate storte o simpatie personali), la macchina inevitabilmente confermerà al paziente quello che già sa o crede di sapere, dando buoni consigli, ma non potendo modulare gli stessi per evitare di trasformare un disagio in una specie di strumento aggressivo o autodistruttivo.

INTELLIGENZA ARTIFICIALE E PSICOLOGIA: L’A.I. COME PROLUNGAMENTO DELLE NOSTRE OMBRE

Quello, dunque, che capiamo è che l’intelligenza artificiale diventa, o è già diventata, un prolungamento delle nostre ombre, non solo delle nostre risorse.

L’I.A. a cui si rivolge un paziente con una particolare sfaccettatura personologica verrà rassicurato, ma potrebbe venire confermato nella sua visione (che è in qualche modo distorta) del mondo e di sé. Dunque il rischio è che si possa arrivare a processi confirmatori e bias di ragionamento, come la generalizzazione e il confirmation bias, che sono degenerazioni che fermano i processi di guarigione, portando il paziente su un percorso che dall’accettazione potrebbe arrivare all’affezione al proprio disagio.

L’I.A. cioè diventa un’amica a cui confessare le nostre fantasie, le nostre ossessioni, i nostri dilemmi esistenziali. Amica autorevole e poco rischiosa. Ma questo rivolgersi a lei rischia di diventare, oltre che spersonalizzante, una sorta di fuga dai rapporti intimi e dallo scambio autentico con gli altri.

Credits: Foto di Adobe Stock | Angelmaxmixam

È necessario, quindi, tenere sotto controllo questo sistema che dà a chi soffre di disagi mentali la possibilità rischiosa di gestire in prima persona i propri problemi, dai quali, invece, deve imparare a distaccarsi il più possibile: da “amica confortante”, infatti, l’intelligenza artificiale può facilmente diventare una “cattiva consigliera”. Non essendo in grado di contraddire assertivamente chi le si rivolge, come detto, con certe sfumature personologiche potrebbe finire per assecondare i bias e le distorsioni di giudizio, invece che tenerli sotto controllo o addirittura eliminarli.

PERCHÉ CI AFFIDIAMO ALL’INTELLIGENZA ARTIFICIALE?

Rimane aperta la domanda: perché ci affidiamo all’intelligenza artificiale, quale è la ragione?

Forse la risposta è che, in fondo, ognuno di noi ha qualche volta fantasticato di avere un amico speciale che potesse aiutarci a risolvere i nostri problemi, senza giudicare, avendo la risposta sempre pronta, l’ascolto sempre disponibile, il consiglio sempre giusto.

Credits: Foto di Adobe Stock | Wanan

Forse oggi abbiamo l’illusione di aver trovato questo amico/chimera nel democratico, insonne e sempre reperibile ChatGPT?

Firma

Dott. Giuseppe Femia, Psicologo, Psicoterapeuta, Psicodiagnosta, Scuola di Psicoterapia Cognitiva (SPC) e dell‘Associazione di Psicologia Cognitiva (APC), Socio Sitcc – Società Italiana di Terapia Comportamentale e Cognitiva.

Se siete interessati ad altri post del Dottor Femia, non perdetevi:

1) IL POTERE DEI RICORDI D’INFANZIA: COME IL PASSATO INFLUENZA IL PRESENTE

3) INVIDIA: COS’É, COME FUNZIONA, COME E DOVE SI MANIFESTA E UTILI RIMEDI

Speriamo che questo post del Dottor Femia sull’uso dell’intelligenza artificiale nella psicologia vi possa far riflettere. Condividete il post con coloro che usano spesso l’A.I. per porre domande e quesiti, anche esistenziali. Un bacione dal TeamClio!